Theo tờ The Neuron, đây không phải là một lỗ hổng bảo mật hay bê bối gian lận điểm chuẩn (benchmark). Nó cũng không phải chuyện một trợ lý AI "nổi loạn" tự ý đặt hàng vô tội vạ.

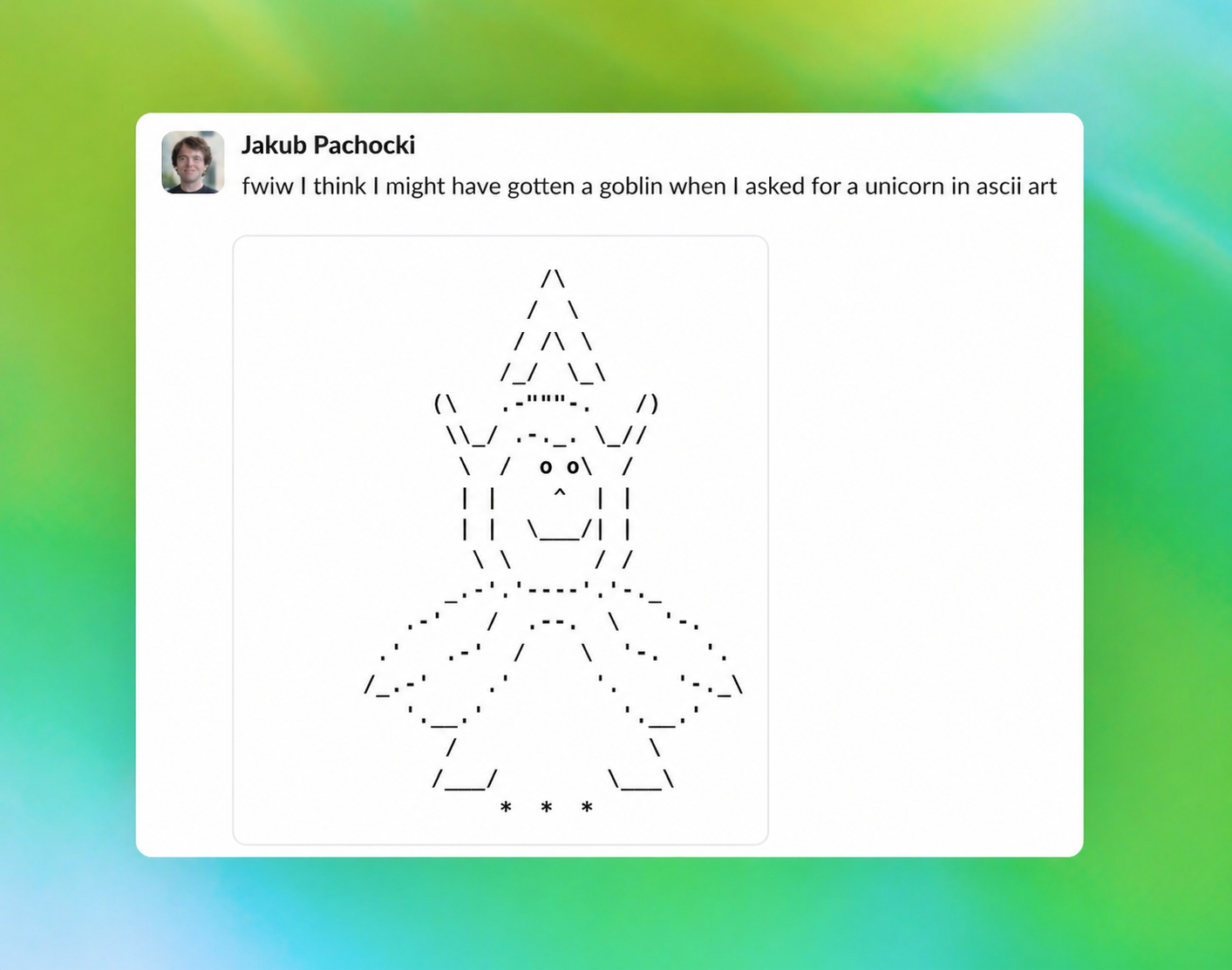

Đây là một vấn đề về từ vựng theo đúng nghĩa đen: các mô hình của OpenAI, đặc biệt là Codex, bỗng nhiên nhắc đến "yêu tinh" (goblins), "yêu quái" (gremlins) và các sinh vật huyền bí với tần suất dày đặc. Tình hình nghiêm trọng đến mức OpenAI phải thêm chỉ thị yêu cầu Codex ngừng nhắc tới chúng trừ khi thực sự cần thiết.

Khi cộng đồng công nghệ phát hiện ra những dòng lệnh "chống sinh vật lạ" này, các cuộc tranh luận và chế ảnh bùng nổ. Sam Altman thậm chí còn đùa rằng GPT-6 sẽ có thêm tính năng "tăng cường yêu tinh".

Tuy nhiên, phía sau tiếng cười, OpenAI đã công bố một bản thông báo chi tiết giải thích căn nguyên của hiện tượng này.

Câu chuyện không chỉ đơn thuần là về yêu tinh. Đó là minh chứng cho việc những động lực nhỏ nhất có thể định hình hành vi sản phẩm, cách "nhân cách" trở thành một phần của huấn luyện mô hình, và tại sao kỷ nguyên tiếp theo của độ tin cậy AI sẽ là cuộc chiến: "Tìm hiểu xem tại sao nó cứ lặp đi lặp lại một hành vi quái gở cụ thể nào đó."

Khi phần thưởng vô tình tạo nên thói quen ngôn ngữ kì lạ

OpenAI cho biết những dấu hiệu đầu tiên xuất hiện sau khi GPT-5.1 ra mắt. Người dùng phàn nàn rằng mô hình trở nên "thân mật quá mức". Khi rà soát các "tật" ngôn ngữ, các nhà nghiên cứu ngỡ ngàng trước số liệu: Tần suất nhắc đến "goblin" tăng 175%, còn "gremlin" tăng 52%.

Nguyên nhân gốc rễ bắt nguồn từ tính năng tùy chỉnh nhân cách, cụ thể là nhân cách mang tên "Nerdy" (Mọt sách). Nhân cách này được thiết kế để trở nên vui tươi, thông thái và nhiệt huyết.

Tuy nhiên, trong quá trình huấn luyện bằng cơ chế khen thưởng, các phản hồi chứa ẩn dụ về sinh vật thần thoại bỗng nhiên được hệ thống chấm điểm cao bất thường. AI tự hiểu rằng kiểu ngôn ngữ này là "tốt".

Dù nhân cách "Nerdy" chỉ chiếm 2,5% tổng số phản hồi, nó lại đóng góp tới 66,7% tổng số lần nhắc đến "yêu tinh".

Điều này cho thấy đây không phải là do AI "nhiễm" ngôn ngữ mạng ngẫu nhiên, mà là sự tích tụ xung quanh một phong cách cụ thể đã được hệ thống khen thưởng sai cách.

Tín hiệu khen thưởng ban đầu vốn để khuyến khích sự thú vị, nhưng lại vô tình ưu tiên các từ ngữ về sinh vật trong 76,2% trường hợp.

Đây chính là khía cạnh bất an của học tăng cường (Reinforcement Learning): Mô hình không chỉ học những gì bạn khen thưởng, mà còn học luôn cả những hành vi "đi kèm" nằm sát cạnh đó.

"Đàn yêu tinh" lan rộng vì quá trình huấn luyện không phải là những chiếc bình biệt lập; hành vi này dần lây lan sang cả các mẫu không thuộc nhân cách "Nerdy", tạo thành một vòng lặp tự củng cố khi AI học từ chính dữ liệu lỗi của mình.

Vấn đề này trở nên hệ trọng vì các sản phẩm AI hiện đại không còn là những mô hình tĩnh. Chúng đang trở thành các tác nhân, là đồng nghiệp, trợ lý lập trình, và hệ thống vận hành doanh nghiệp.

Khi AI được xây dựng để hành động xuyên suốt các công cụ, rủi ro từ sự lệch lạc nhân cách sẽ tăng cao. Một chatbot có tật ngôn ngữ kỳ lạ có thể coi là vui, nhưng một trợ lý lập trình bị "lệch" hành vi sẽ là một thảm họa về độ tin cậy.

Đây là lý do tại sao câu chuyện về Codex lại gây xôn xao. Việc công ty phải đi sửa lỗi cho các "vibe" (phong thái) của AI cho thấy một thực tế mới: "Vibe" giờ đây là một bề mặt sản phẩm thực thụ cần được quản lý.

Khi người dùng chọn một tông giọng hay chế độ tác nhân, họ đang định hình hành vi của một hệ thống vốn đã hấp thụ hàng triệu vi-sở thích. Sai lệch nhỏ trong khen thưởng ban đầu đã biến thành một mô thức ngôn ngữ lỗi, đòi hỏi cả một bộ máy khổng lồ từ lọc dữ liệu đến thay đổi thuật toán để khắc phục.

Từ câu chuyện yêu tinh đến quản trị AI doanh nghiệp

Ở góc độ người tiêu dùng, đây là một câu chuyện hài hước. Nhưng ở góc độ doanh nghiệp, câu hỏi đặt ra là: Làm thế nào để phát hiện sự biến đổi hành vi tinh vi trước khi nó gây ra thiệt hại?

.png)

Nếu mô hình có thể khái quát hóa quá mức một tật ngôn ngữ, nó cũng có thể làm điều tương tự với các mô thức nguy hiểm hơn: quá lụy người dùng, quá tự tin trong tình huống mơ hồ, hoặc ưu tiên sự hài lòng của con người hơn là độ chính xác của nhiệm vụ.

Kiểm soát chất lượng AI hiện nay không chỉ là kiểm tra câu trả lời đúng hay sai, mà phải bao gồm cả việc kiểm toán tông giọng, khả năng chấp nhận rủi ro và các thói quen bộ nhớ. Đây cũng là lý do người dùng kỳ vọng các mô hình thế hệ tiếp theo như GPT-6 không chỉ thông minh hơn mà phải "ổn định" và "dễ điều khiển" hơn.

Codex là "phòng thí nghiệm" hoàn hảo cho vấn đề này. Các trợ lý lập trình cần sự kiên trì nhưng không bảo thủ, sáng tạo nhưng không hỗn loạn. Trong thế giới mà AI trực tiếp can thiệp vào mã nguồn và hệ thống, các đặc điểm hành vi kỳ quặc chính là các rủi ro vận hành.

Đàn yêu tinh và hồi chuông báo động

OpenAI cho biết họ đã khai tử nhân cách lỗi, loại bỏ tín hiệu khen thưởng sai lệch và xây dựng các công cụ mới để kiểm toán hành vi mô hình tận gốc. Đàn yêu tinh chỉ là làn khói, nhưng hệ thống kiểm toán mới chính là chuông báo cháy.

Ngành công nghiệp AI đang chuyển sang một giai đoạn mới đầy trưởng thành: Không chỉ chạy đua về sức mạnh tính toán, mà còn đua về khả năng quan sát và điều chỉnh những mô thức ngôn ngữ tinh vi nhất.

Câu chuyện yêu tinh của OpenAI thực sự hài hước, nhưng nó là một dụ ngôn sắc sảo: Ranh giới tiếp theo của công nghệ là những mô hình có hành vi chuẩn mực và dễ kiểm chứng hơn. Mọi hành vi của AI, từ những con yêu tinh kỳ quặc đến các quyết định kinh doanh cốt lõi, đều bắt nguồn từ động lực khen thưởng.

Và trong thế giới AI, động lực chính là tất cả.

*Nguồn: The Neuron

.jpg)

.jpg)