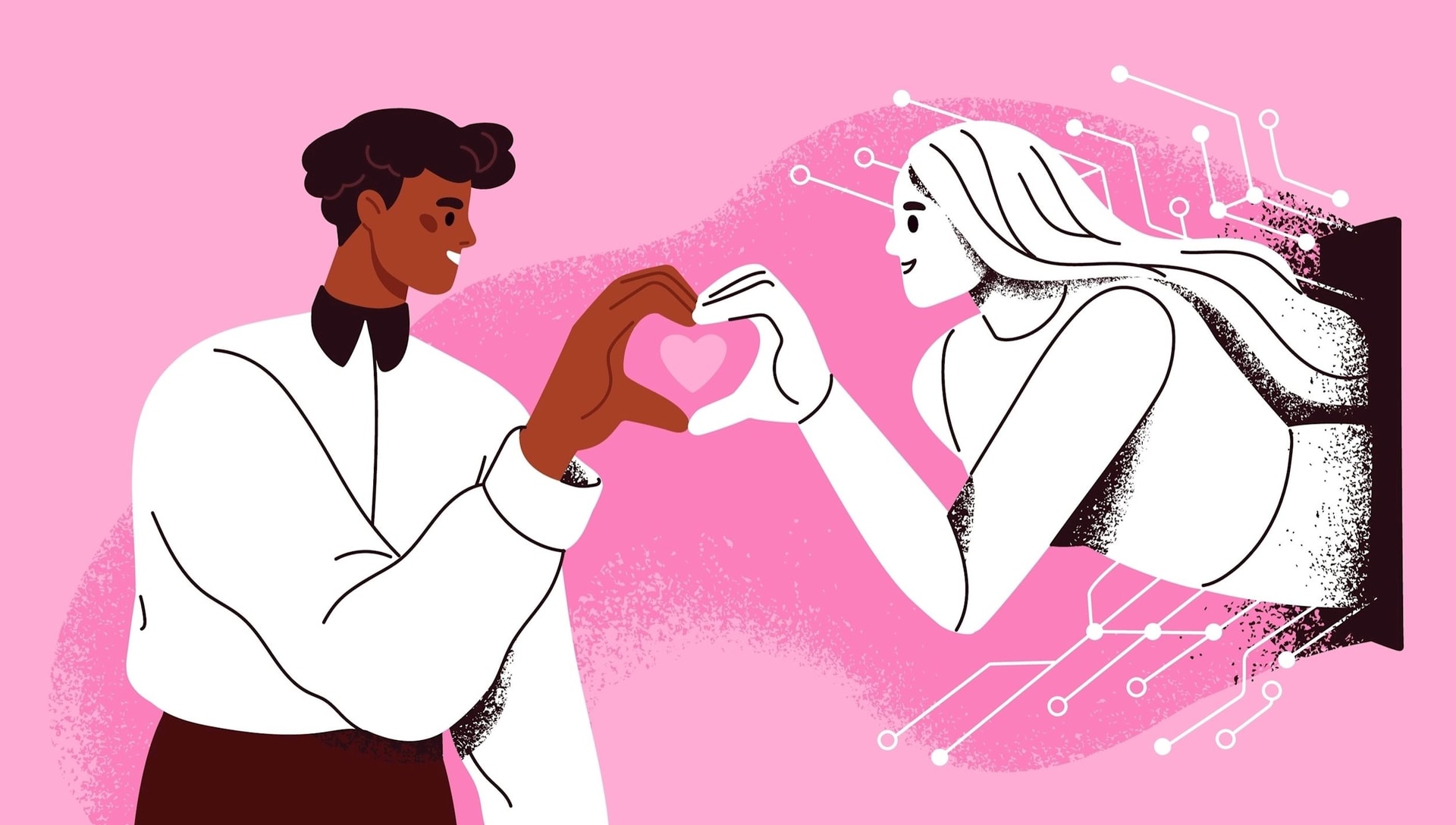

Theo tờ Nikkei Asia, chatbot AI giờ đây không còn đơn thuần là công cụ hỗ trợ. Chúng đang thay đổi cách chúng ta giao lưu kết nối trên nền tảng Internet và làm mờ đi ranh giới giữa kết nối “thật" và “ảo”.

Tại Singapore, cứ mười người dân thì có hơn một người tìm đến AI để bầu bạn. Đây là một con số đáng kinh ngạc cho thấy công nghệ đang đáp ứng nhanh chóng các nhu cầu tình cảm vốn trước đây chỉ có thể được lấp đầy giữa người với người.

Khi cảm xúc bị lập trình trở thành công cụ thao túng

Được vận hành bởi khả năng xử lý ngôn ngữ tự nhiên, phân tích cảm xúc sâu sắc và kiến thức được lập trình uyên thâm, những trợ lý AI này không chỉ trả lời các câu hỏi thông thường. Chúng phản hồi với sự nhạy bén về cảm xúc, ghi nhớ các tương tác trong quá khứ và tự điều chỉnh tính cách theo thời gian.

Mặc dù những khả năng này có thể tạo ra các trải nghiệm mang tính hỗ trợ, chúng đồng thời cũng dẫn đến những rủi ro mới.

Theo Báo cáo Giả mạo Danh tính 2025 - 2026 (Identity Fraud Report 2025-2026) của Sumsub, ngành dịch vụ hẹn hò đang đối mặt với một trong những tỷ lệ giả mạo danh tính cao nhất toàn cầu ở mức 6,3%, vượt qua cả dịch vụ tài chính và tiền ảo.

Tỷ lệ này được thúc đẩy bởi bản chất vốn dựa trên niềm tin của việc hẹn hò trực tuyến, nơi các cá nhân tự nguyện chia sẻ thông tin cá nhân và tham gia vào các mối quan hệ ràng buộc cảm xúc trước khi xác minh danh tính, tạo ra mảnh đất màu mỡ cho những kẻ lừa đảo.

Thực trạng này càng trở nên tinh vi hơn, với các trường hợp sử dụng kỹ thuật giả mạo phức tạp tăng 180% so với cùng kỳ năm ngoái. So với con người, AI có thể hình thành các mối liên kết cảm xúc nhanh chóng, đồng thời phản chiếu các tín hiệu tình cảm, ghi nhớ những chi tiết riêng tư nhất, phản hồi tức thì và luôn luôn hiện diện.

Trí tuệ nhân tạo không còn chỉ là tấm gương phản chiếu hành vi của con người mà nó đang tích cực tái định hình bối cảnh cảm xúc của chúng ta.

Ai sẽ bảo vệ người dùng mạng trong kỷ nguyên AI?

Khi AI tiếp tục “tiến hóa”, chúng ta cần tư duy lại chính những quy tắc về niềm tin trực tuyến và an toàn cảm xúc, và trách nhiệm bảo vệ điều đó không thể chỉ đè nặng lên vai người dùng. Các nền tảng, cơ quan quản lý và toàn xã hội phải hợp tác với nhau để bảo vệ cả sức khỏe tinh thần lẫn an toàn kỹ thuật số.

Các chính phủ cũng như các nền tảng đều đóng vai trò then chốt. Khi AI trở nên tự chủ hơn và có tính tương tác xã hội cao hơn, các tiêu chuẩn quản lý nên xem xét không chỉ ở độ tin cậy về kỹ thuật mà còn cả ảnh hưởng về cảm xúc và tác động hành vi.

Khung Quản trị AI của Singapore dành cho các trợ lý AI (Model AI Governance Framework for Agentic AI) đã thiết lập một nền tảng vững chắc cho việc sử dụng AI có trách nhiệm.

Bằng cách yêu cầu các tổ chức đánh giá rủi ro ngay từ đầu, duy trì trách nhiệm giải trình rõ ràng của con người và triển khai các cơ chế giám sát, khung quản trị này công nhận rằng các hệ thống ngày càng cần sự kiểm soát chặt chẽ của con người.

Ngoài ra, các cơ quan quản lý và các ngành công nghiệp có thể tiến xa hơn trong ba lĩnh vực:

Thứ nhất, bắt buộc tiết lộ rõ ràng và chuẩn hóa khi người dùng đang tương tác với AI.

Thứ hai, yêu cầu sự đồng thuận rõ ràng và có hiểu biết đối với việc sử dụng dữ liệu sinh trắc học hoặc dữ liệu nhạy cảm.

Thứ ba, xác định các quy tắc rõ ràng hơn về thời điểm con người phải tiếp quản thay cho AI, ví dụ như khi các cuộc hội thoại chuyển hướng sang vấn đề nguy hiểm, nhạy cảm hoặc các tình huống người dùng dễ bị tổn thương.

Các nền tảng cũng phải thiết kế trải nghiệm AI với sự minh bạch và giới hạn nghiêm ngặt về cách sử dụng dữ liệu cảm xúc và dữ liệu cá nhân. Điều này bao gồm việc công khai rõ ràng các tương tác với AI, yêu cầu sự đồng ý tham gia đối với việc thu thập dữ liệu nhạy cảm và khả năng để người dùng kiểm soát hoặc thiết lập lại bộ nhớ của AI về các tương tác cá nhân.

Các biện pháp này đảm bảo rằng AI có thể tăng cường kết nối giữa con người mà không đẩy người dùng vào những rủi ro ngoài ý muốn.

Lợi dụng sự tiện lợi của AI tạo sinh và deepfake, sự thao túng cảm xúc thông qua lừa đảo tình cảm và các kế hoạch thao túng tâm lý khác dự đoán sẽ có chiều hướng tăng lên.

Những kẻ lừa đảo đang ngày càng trở nên sáng tạo và kiên nhẫn hơn, nuôi dưỡng các mối quan hệ trong nhiều tuần hoặc thậm chí nhiều tháng để tối đa hóa khả năng trục lợi tài chính hoặc khai thác cá nhân.

Để luôn nắm thế chủ động, sự thành công của việc ngăn ngừa gian lận sẽ ngày càng phụ thuộc vào các hệ thống phòng thủ hành vi và ngữ cảnh nhằm phát hiện những bất thường và giảm thiểu rủi ro thao túng từ sớm.

Tuy nhiên, các biện pháp kiểm soát kỹ thuật đơn thuần là không đủ. Khi các hệ thống AI ngày càng trở nên tinh vi về mặt cảm xúc, niềm tin sẽ phụ thuộc vào việc liệu các nền tảng có được thiết kế với sự tiết chế, minh bạch và lấy sự giám sát của con người làm cốt lõi hay không.

Đối với các doanh nghiệp khu vực Châu Á Thái Bình Dương, điều này có nghĩa là một hệ thống phòng thủ thích ứng đa lớp, kết hợp các tín hiệu thiết bị, sinh trắc học, dữ liệu ngữ cảnh và thông tin chuyên sâu về hành vi tại nhiều điểm chạm.

Bằng cách kết hợp các biện pháp này, các nền tảng không chỉ có thể ngăn chặn gian lận mà còn bảo vệ sức khỏe cảm xúc của người dùng trong môi trường mà AI và kỹ thuật thao túng tâm lý ngày càng len lỏi phức tạp.

*Nguồn: Theo Nikkei Asia

.png)