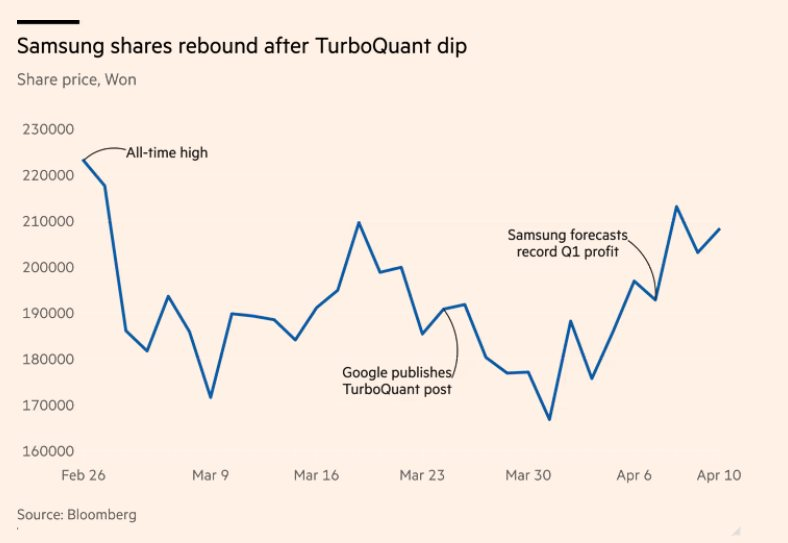

Thị trường bán dẫn vừa trải qua những tuần đầy biến động khi những thông tin về thuật toán TurboQuant được Google Research công bố.

Công nghệ này hứa hẹn cắt giảm mạnh lượng bộ nhớ cần thiết để vận hành trí tuệ nhân tạo (AI), trực tiếp đánh vào "nồi cơm" của các nhà sản xuất chip nhớ băng thông cao (HBM) như Samsung Electronics và SK Hynix. Tuy nhiên, thay vì một kịch bản sụp đổ, thực tế đang chứng minh một nghịch lý thú vị của nền kinh tế số.

Tờ Financial Times (FT) cho hay trong khi giới đầu tư còn đang lo ngại về việc thuật toán tiết kiệm bộ nhớ TurboQuant của Google có thể dập tắt cơn sốt chip nhớ, kết quả kinh doanh bùng nổ của Samsung như một lời khẳng định đanh thép: Càng hiệu quả, thế giới càng cần nhiều chip hơn.

Bước ngoặt

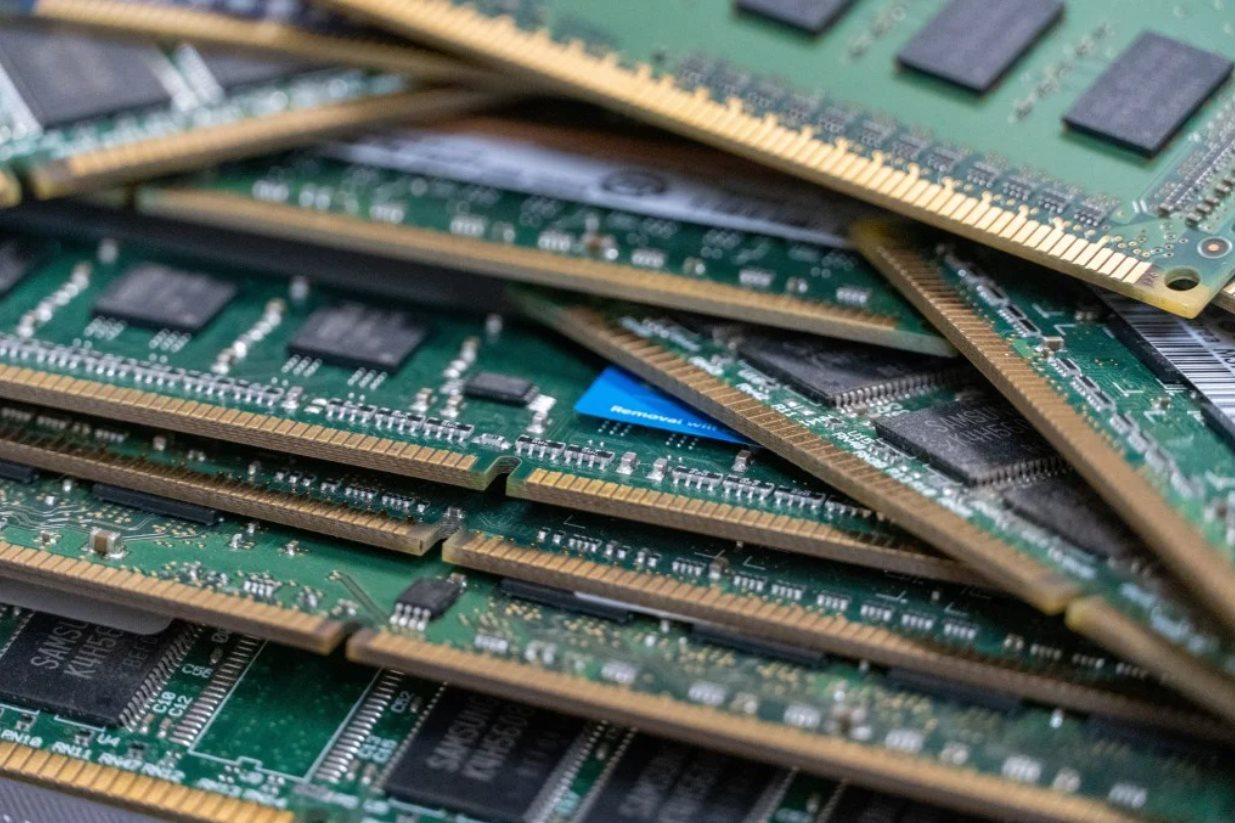

Samsung Electronics vừa đưa ra ước tính lợi nhuận quý I cao hơn cả tổng lợi nhuận của cả năm ngoái cộng lại. Con số này không chỉ xoa dịu nỗi lo của các cổ đông mà còn cho thấy tình trạng "nút thắt cổ chai" về bộ nhớ đối với các công ty AI vẫn chưa có dấu hiệu hạ nhiệt.

Theo báo cáo từ Samsung, thị trường đang bước vào một "siêu chu kỳ chưa từng có", nơi mà nhu cầu về chip nhớ bền bỉ và mạnh mẽ hơn bao giờ hết.

Giá cổ phiếu của gã khổng lồ Hàn Quốc đã áp sát mức cao kỷ lục ngay sau khi thông tin này được công bố. Điều này cho thấy niềm tin của thị trường vào việc công nghệ mới không những không làm giảm nhu cầu mà còn có thể là động lực thúc đẩy quy mô ngành bán dẫn lên một tầm cao mới.

Để hiểu tại sao TurboQuant lại gây xôn xao, chúng ta cần nhìn vào cách nó vận hành. Thuật toán này hoạt động bằng cách nén "KV cache", một dạng bộ nhớ ngắn hạn cho phép các mô hình ngôn ngữ lớn như ChatGPT hay Claude ghi nhớ ngữ cảnh hội thoại. Google khẳng định giải pháp này có thể cắt giảm tới 6 lần lượng bộ nhớ sử dụng mà không làm giảm đáng kể độ chính xác.

Ông Han In-su, một trong những nhà nghiên cứu có công trình làm nền tảng cho TurboQuant, nói rằng thuật toán này "có thể phục vụ như một nền tảng để hiện thực hóa các nhiệm vụ khó khăn mà trước đây không thể thực hiện được, chẳng hạn như xử lý các ngữ cảnh dài hơn nhiều trong nguồn tài nguyên bộ nhớ hạn chế mà không làm mất đi độ chính xác, hoặc triển khai AI hiệu suất cao trên các thiết bị nhỏ hơn".

Tương tự, giáo sư Kwon Seok-joon tại Đại học Sungkyunkwan nhận định rằng TurboQuant có tiềm năng cắt giảm chi phí vận hành các mô hình ngôn ngữ từ 4 đến 8 lần.

"TurboQuant tiềm năng cắt giảm chi phí vận hành các mô hình ngôn ngữ lớn từ 4 đến 8 lần. Thoạt nhìn, điều này có vẻ đe dọa nhu cầu đối với các chip nhớ băng thông cao”, giáo sư Kwon nói.

Trên lý thuyết, nếu một hệ thống cần ít bộ nhớ hơn để chạy, nhu cầu mua sắm chip mới sẽ giảm xuống. Đây chính là nguyên nhân khiến cổ phiếu của Samsung và SK Hynix sụt giảm mạnh trong tháng trước khi các nhà đầu tư vội vã bán tháo vì lo ngại thời kỳ hoàng kim của chip nhớ sắp kết thúc.

Tuy nhiên, các nhà phân tích lại đang nhìn thấy một kịch bản khác dựa trên "Nghịch lý Jevons", một lý thuyết kinh tế từ năm 1865. Lý thuyết này chỉ ra rằng khi hiệu suất sử dụng một nguồn tài nguyên tăng lên, tổng lượng tiêu thụ nguồn tài nguyên đó thực tế sẽ tăng thay vì giảm, bởi vì chi phí rẻ hơn khiến nó trở nên khả thi trong nhiều bối cảnh mới.

Nhà kinh tế học William Stanley Jevons đã lưu ý trong cuốn sách "The Coal Question" năm 1865 của mình rằng động cơ hơi nước hiệu quả hơn của James Watt đã dẫn đến việc sử dụng nhiên liệu nhiều hơn, vì nó làm cho các công nghệ chạy bằng than trở nên khả thi về mặt kinh tế trong nhiều bối cảnh hơn.

Đồng quan điểm, giáo sư Kwon phân tích thêm rằng việc suy luận AI trở nên rẻ hơn một cách đột biến sẽ mở ra những khối lượng công việc vốn trước đây được coi là quá đắt đỏ để thực hiện. Đó có thể là các trợ lý mã hóa thời gian thực hoặc hàng loạt tác tử AI chạy đồng thời. Khi đó, tổng nhu cầu tính toán và lưu trữ sẽ tăng vọt, kéo theo nhu cầu về chip nhớ tăng theo tỷ lệ thuận.

Lịch sử cũng đã từng chứng minh điều này qua công nghệ Kubernetes của Google. Khi mới ra đời, giới công nghệ lo ngại nó sẽ làm giảm nhu cầu máy chủ vì giúp chạy nhiều ứng dụng hơn trên một phần cứng. Nhưng thực tế, chi phí thấp đã khuyến khích việc sử dụng rộng rãi hơn, dẫn đến sự bùng nổ của hạ tầng trung tâm dữ liệu.

Thay đổi cuộc chơi: Từ bán lẻ sang hợp đồng dài hạn

Một yếu tố khác giúp các nhà sản xuất chip Hàn Quốc tự tin trước làn sóng thuật toán mới là sự thay đổi trong cấu trúc vận hành thị trường. Ray Wang, chuyên gia từ hãng nghiên cứu SemiAnalysis, cho biết bộ nhớ đang dần mất đi tính chu kỳ thất thường nhờ nhu cầu AI bền vững. Các nhà cung cấp dịch vụ AI đang nỗ lực "đặt chỗ" trước bằng các hợp đồng dài hạn để đảm bảo nguồn cung.

Ông Jun Young-hyun, đồng Giám đốc điều hành của Samsung, xác nhận công ty đang chuyển dịch từ các điều khoản ký kết theo quý hoặc hàng năm sang các hợp đồng kéo dài 3 đến 5 năm với các khách hàng lớn. Điều này tạo ra một tấm đệm an toàn về doanh thu, giúp Samsung và SK Hynix miễn nhiễm tốt hơn trước các biến động về mặt thuật toán hay tâm lý thị trường ngắn hạn.

Hiện tại, TurboQuant vẫn mới dừng lại ở mức độ ý tưởng trong một bài đăng học thuật của Google và sẽ được trình bày chi tiết tại Hội nghị quốc tế về Biểu diễn học tập (ICLR) tại Brazil vào cuối tháng 4.

Tuy nhiên, dù thuật toán này có thành công đến đâu, có vẻ như thế giới vẫn sẽ không ngừng "khát" chip nhớ.

"Chúng tôi chưa bao giờ tưởng tượng rằng một công nghệ bắt đầu từ câu hỏi học thuật về 'Làm thế nào chúng ta có thể nén dữ liệu hoàn hảo hơn?' lại có thể gây ra hiệu ứng gợn sóng kinh tế và xã hội lớn đến như vậy," giáo sư Han In-su nói.

*Nguồn: FT, The Verge